От эскалации конфликтов до выманивания денег – как мошенники используют искусственный интеллект?

Что тут таить, ложь продается лучше. А фейки используют для достижения самых разных целей – от климатической активности до эскалации конфликтов и выманивания денег. Наверное, остались считанные люди на планете, которым бы не позвонили телефонные экстремисты.

Используя дипфейки, преступники выманивают огромные суммы. Моделируют голоса родственников, начальников – и вот уже не понять, кто есть кто в этой большой мошеннической схеме. В 2022-м с помощью сгенерированных голосов было похищено около 11 миллионов долларов, сообщили в программе «Неделя» на СТВ.

Между фейком и реальностью – материал Арины Поповой.

Должен был перечислить определенную сумму, 2 тысячи рублей. И получается, что сделки проходят на фондовом рынке.

Такой вариант зарабатывать на крипте до 200 долларов в месяц и ничего при этом не делать предложила Никите знакомая. Казалось бы, если такие подозрительно выгодные условия озвучит чужой человек, мало кто согласится. Только потом окажется: это одна из действенных схем. Мошенники сначала втираются в доверие, после пропадают навсегда. Причем, как потом выяснится через общих знакомых, отрабатывался этот механизм задолго до встречи с Никитой.

Обманула свой офис в 2023-м году весь, потом она обманула своих родителей, сестру, своего мужа. Она уже этим занимается как минимум 1,5 года, и мы пытались подсчитать приблизительную сумму, которую она таким способом себе в карман положила. И это получилось в районе 70 тысяч долларов.

Правда, небольшую часть денег знакомая через время вернет. Так делают часто, чтобы усыпить доверие и попросить сумму еще больше. Именно на этом этапе молодой человек и заподозрит неладное и спросит, где обещанный заработок из того, что он уже перевел. Начнутся оправдания: технические проблемы, переезд, в ход пошли и кощунственные отмазки – смерть дочери.

Никита Чепурин, потерпевший:

На самом деле у меня уже были такие случаи, когда мне звонили всякие мошенники по телефону и я просто им подыгрывал. Они мне звонят, говорят: вы выиграли квартиру. Я такой: боже мой, нет! Я выиграл квартиру! Спасибо вам! И говорю им: спасибо, что пытаетесь меня обмануть, и клал трубку. А тут совсем другая история.

Так можно поступить, если выманить деньги пытается незнакомый человек. Но как совладать с эмоциями, когда на другом конце провода дрожит голос, к примеру, родного сына? Впервые о подделывании голоса с использованием искусственного интеллекта стало известно несколько лет назад. Тогда в основном прикидывались родственниками, которые попали в беду. В последнее время в СНГ все чаще стали применять уловку «поддельный начальник».

Петр Микула, начальник отдела анализа практики и методического обеспечения предварительного расследования управления Следственного комитета по Минску:

Создание полной иллюзии того, что вы разговариваете именно с собственным руководителем, то есть у вас будет отображаться номер телефона соответствующий, никнейм, фотография. Все мы общаемся со своими руководителями в том числе и посредством сети Интернет, посредством мессенджеров. И отличить настоящего своего руководителя от поддельного, фейка – достаточно сложно.

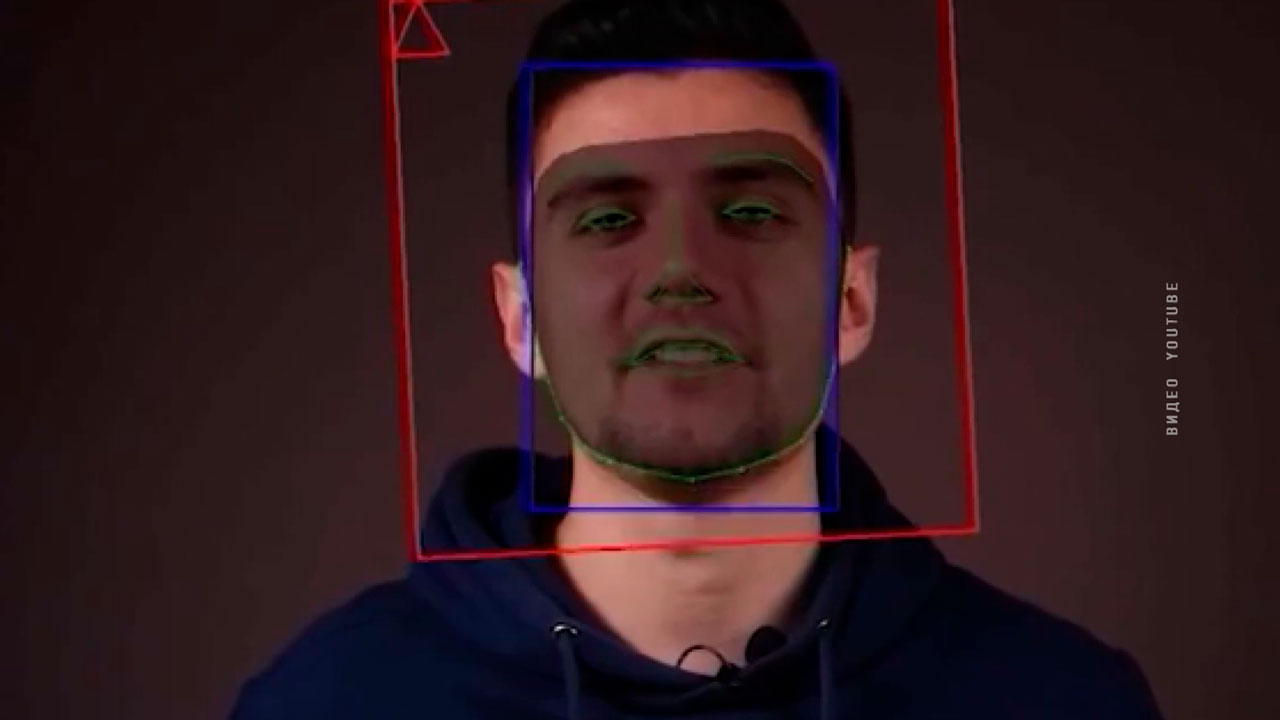

Причем с помощью искусственного интеллекта мошенники не только подделывают голос. Лицо тоже больше не часть вашей индивидуальности. Благодаря технологии «дипфейк» можно скомпрометировать любого человека: приписать ему чуждые фразы и даже действия. Начали применять эту опцию в 2017-м, подменяя лица в фильмах, правда, речь про контент 18+. Потом мода дошла и до голливудских актеров.

Технология дипфейк – это искусственный интеллект, который сам себя обучает. Представьте, что тот, кто рисует поддельные картины, и эксперт по фальшивкам объединились. И первый анализирует изображения с разных ракурсов и пытается создать такое же. Задача второго – определить, какие варианты наиболее правдоподобны. Так и формируется мимика и речь, скажем, Моргана Фримена.

Но фейки активно распространяют и вблизи наших рубежей. Так, во время СВО с территории Украины рассылали ложные сообщения о мобилизации. Также с территории Украины и стран ЕС стали активно применять так называемые сим-боксы, чтобы создать видимость того, что вам звонят из какой-то российской структуры.

У многих только сейчас открылись глаза на события 2020 года уже во время нашей президентской кампании. Ведь именно тогда в самых разных чатах как из рога изобилия посыпались тысячи провокационных видео. И было уже не отличить, где правда, а где провокация. Чтобы это сделать, эксперты советуют детально рассмотреть, нет ли рассинхрона в видео, обратить внимание на качество картинки и помнить, если файл вызвал у вас сильную эмоцию, вами пытаются управлять.

Подробности в видео.