От финансового мошенничества до информационного шума – рассказываем о дипфейках

Технологии технологиями, но все хорошо в меру, как говорится. В мире уже давно пытаются взять под контроль эту сферу, сообщили в программе «Неделя» на СТВ.

На неделе стало известно, что Италия первой в Европе приняла большой закон, который регулирует использование искусственного интеллекта. В частности, за создание дипфейков ввели тюремные сроки. Можно получить от года до пяти лет. Все зависит от тяжести последствий.

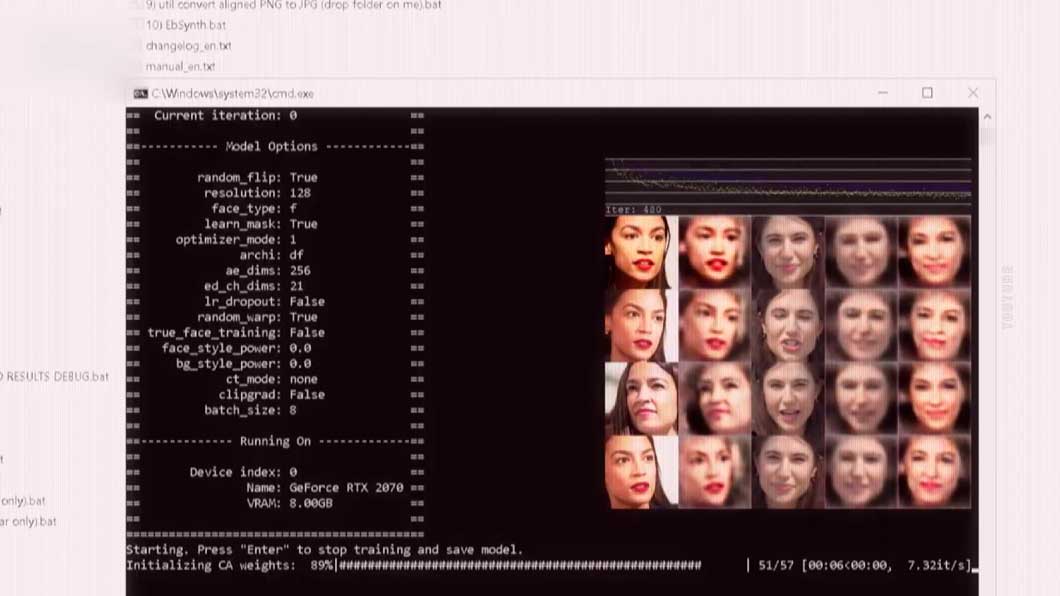

К примеру, в последнее время эту технологию активно освоили и используют мошенники. Подделывают голоса, генерируют изображение. Одним словом, создают настоящую цифровую копию человека и бывают случаи, когда отличить подделку от оригинала сложно даже подготовленному зрителю.

Не волнуйтесь, в неделе никаких фейков. Мы все настоящие. Но журналисты и ведущие, в том числе нашего телеканала, часто натыкаются на своих цифровых клонов, и это не несет ничего хорошего.

Зачем мошенникам наш голос и фото, и как защитить свои данные от похищений – разбирался Глеб Прокофьев.

Честно говоря, у меня остались о Евгении Пригожине самые лучшие воспоминания. Это был человечище. Мне, кстати, Александр Григорьевич кувалду подарил, чтобы мы равнялись на Пригожина.

Это лишь небольшой набор дипфейков. Все чаще подобные инфовбросы появляются в сети. Они преследуют различные цели: от финансового мошенничества и политических манипуляций до банального создания информационного шума.

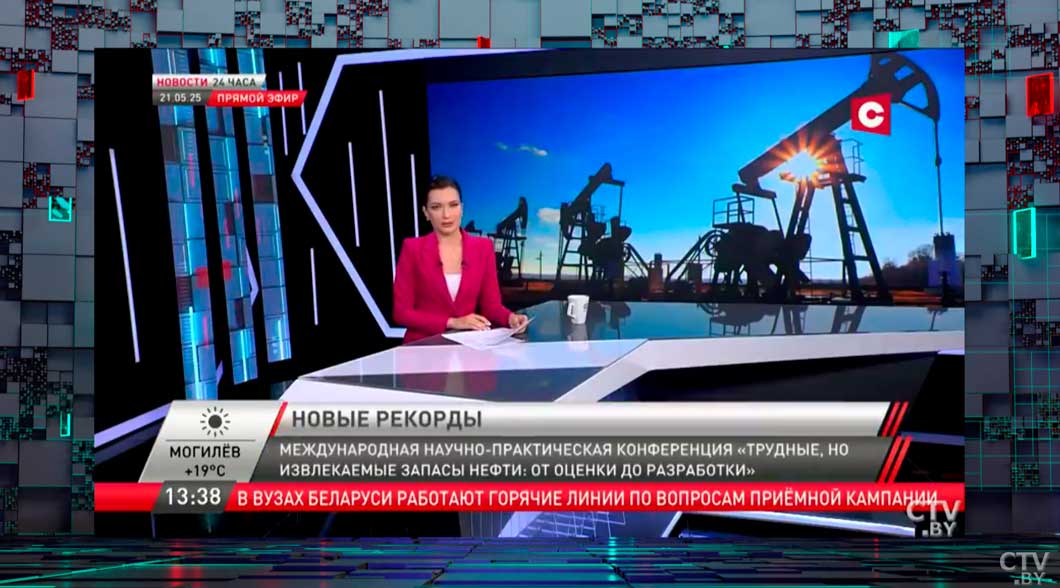

Пользователи нашумевшей платформы от «Беларуснефти» заявляют о невероятных доходах. Мы решили проверить так ли это на самом деле и пообщались с генеральным директором компании.

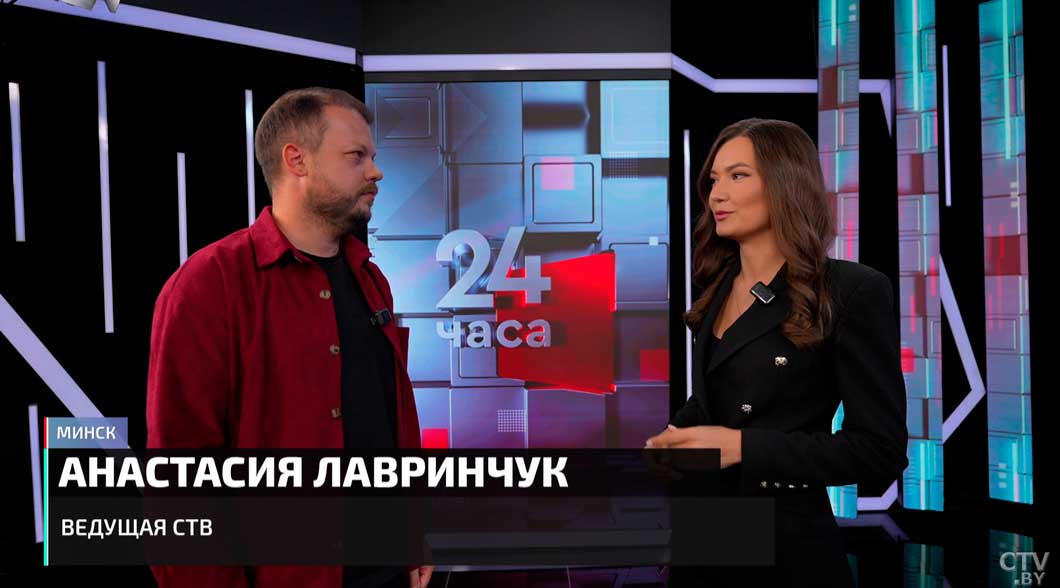

Ведущая СТВ оказалась в числе жертв фейкоделов. В сгенерированном искусственным интеллектом ролике Анастасия Лавренчук якобы рассказывает об «инвестиционной платформе». Увидев это видео, Настя была крайне удивлена.

Анастасия Лавринчук, ведущая СТВ:

Когда в целом видишь такие видео – сразу шок. Во-первых, сделано достаточно качественно. Они взяли мой голос, поменяли, конечно, смысл текста, но мой голос, мои интонации, где-то даже паузы, действительно похожи.

Мы нашли оригинальную запись. Провели сравнительный анализ со сгенерированным видео. Полученное благодаря искусственному интеллекту видео действительно очень похоже на оригинал. Удалось сохранить мимику и артикуляцию ведущей, однако к тембру голоса есть вопросы: при внимательном прослушивании интонация робота все же заметна. Даже родственники Анастасии не сразу поняли, что перед ними дипфейк.

Подробнее смотрите в видео.